| Рубрикатор |  |

|

| Статьи |  |

|

| Владимир КУЗНЕЦОВ | 05 мая 2026 |

ЦОДы для ИИ: модернизация или новая стройка?

Большинство материалов, касающихся модернизации ЦОДов для искусственного интеллекта — как в профильных изданиях, так и на сайтах вендоров, — описывают направления изменений, но редко говорят о том, как их реализовать на практике. Попробуем конкретизировать общие рекомендации.

Пришли зайцы к сове и жалуются:

— Сова, помоги, нас волки едят, житья нет!

Сова подумала и говорит:

— Вам надо стать волками.

Зайцы обрадовались, побежали, но через некоторое время вернулись:

— Сова, а как нам стать волками?

Сова раздраженно отвечает:

— Вы меня по пустякам не отвлекайте. Я занимаюсь стратегией.

Старый анекдот

Модернизация ЦОДа для ИИ-задач, связанная с размещением стоек с GPU-серверами, подразумевает в первую очередь увеличение мощности систем электропитания и охлаждения. Энергопотребление GPU-стоек может достигать 50–100 кВт и выше, тогда как традиционные системы обычно укладываются в диапазон 5–15 кВт. Такие проекты редко выполняются как одномоментная перестройка всей площадки. Необходимость поддерживать работу сервисов заставляет ограничиваться изменением отдельных зон.

Выделение зон для ИИ-нагрузок связано с перераспределением пространства. Часть обычных стоек убирают, а для GPU-серверов формируют участки с собственными контурами питания, охлаждения и сетью: прокладывают отдельные линии питания или шинопроводы, создают контур охлаждения, разворачивают высокоскоростную сеть.

Электропитание для высокоплотных стоек

Основные сложности связаны с подведением мощности к стойке — классические кабельные линии и PDU, как правило, подходят плохо.

Для подведения необходимой мощности к стойкам рекомендуется использовать шинопроводы — это технология не новая, но теперь ее начинают применять шире. Шинопровод представляет собой жесткую линию электропитания, которую обычно прокладывают над рядом стоек. К ней подключаются небольшие распределительные модули (коробки отбора мощности), которые устанавливаются прямо на шинопроводе над стойками. От них к каждой стойке идет короткий кабель.

Источник: Data Center Systems, Inc.

Шинопровод с распределительными модулями, подключаемыми к линии над стойками

В отличие от кабельной схемы, где к каждой стойке тянут отдельную линию, здесь одна линия проходит вдоль всего ряда. Это упрощает разводку, снижает нагрев и позволяет подключать новые стойки без перекладки кабелей. Параллельно можно повысить напряжение, что позволяет передавать ту же мощность при меньших токах.

При этом доступная внешняя мощность может быть ограничена, а сроки ее увеличения — значительными. В таких условиях ввод мощностей может выполняться поэтапно.

Жидкостное охлаждение в существующих залах

Для внедрения жидкостного охлаждения в действующих ЦОДах рассматривают два подхода: подключение к существующей системе охлаждения здания или использование автономных решений без такового.

В первом случае задействуют систему охлажденной воды здания. Для подключения в зале устанавливают блок распределения теплоносителя (Cooling Distribution Unit, CDU) — отдельный модуль, через который формируется контур для группы стоек. От него воду подают к оборудованию. Дальше приходится решать, где размещать коллекторы и как прокладывать линии.

Источник: MITA Cooling Technologies

Блок распределения теплоносителя

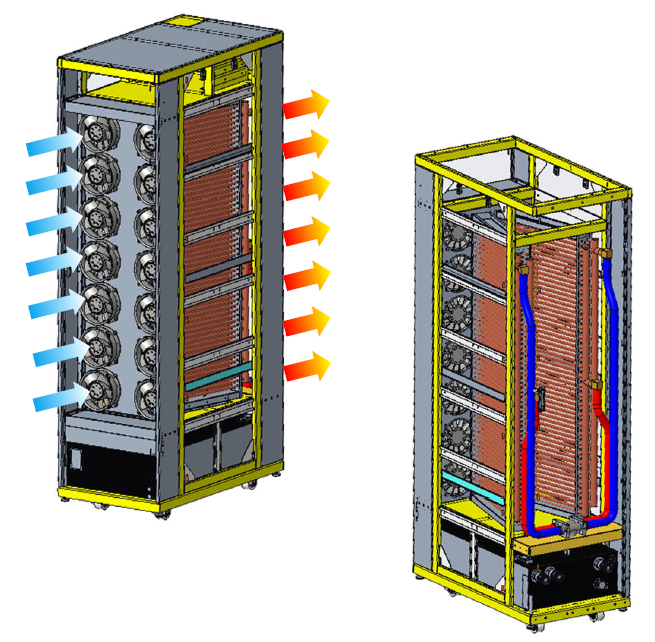

Альтернативный подход — использование замкнутых систем жидкостного охлаждения, когда прокладка труб по залу затруднена или невозможна. В таких решениях жидкость циркулирует через серверы и возвращается в специальный модуль (в англоязычных материалах его часто называют sidecar, дословно «мотоциклетная коляска»), где тепло отводится через теплообменник «жидкость — воздух». Подобный модуль обычно обслуживает одну-две стойки и размещается в торце ряда или вместо одной из стоек. Решение позволяет внедрять жидкостное охлаждение без подключения к системе здания и без изменения магистральных инженерных систем.

Источник: Sunonwealth Electric Machine Industry Co., Ltd.

Sidecar-модуль: замкнутый контур жидкостного охлаждения с отводом тепла в воздух

Для ограниченного увеличения мощности уже эксплуатируемых обычных стойек и их охлаждения могут применяться теплообменники задней двери (rear door heat exchanger, RDHx), которые охлаждают воздух, выходящий из серверов. Вода при этом подводится также от системы охлаждения здания — напрямую или через CDU — и проходит только через теплообменник, не попадая внутрь серверов. Решение не заменяет полноценной схемы охлаждения, используемой для GPU-оборудования.

Источник: SuperMicro

Теплообменник задней двери

Сеть для ИИ

В отличие от питания и охлаждения модернизация сети не предполагает упрощенных сценариев: для GPU-кластера фактически разворачивается отдельная сетевая инфраструктура.

В архитектурах Nvidia для таких систем выделяется отдельная сеть обмена данными между GPU (фабрика), отличная от сети доступа и управления. Это требует установки высокоскоростных коммутаторов (200–400 Гбит/с и более) и прокладки отдельных соединений между серверами и сетевым оборудованием.

Для такой сети используют либо InfiniBand — специализированную высокоскоростную технологию для межсерверного обмена, либо RoCE (Remote Direct Memory Access over Converged Ethernet) — вариант Ethernet, обеспечивающий прямой доступ к памяти серверов с минимальными задержками. Выбор влияет на тип оборудования и требования к настройке сети, но не на сам подход к модернизации: в обоих случаях требуется установка отдельного сетевого оборудования и прокладка новой кабельной инфраструктуры внутри зоны. В GPU-кластерах каждый сервер подключается к сети несколькими линиями, поэтому соединений становится значительно больше, чем в обычных стойках.

Где модернизация целесообразна

Модернизация ЦОДа для ИИ-нагрузок возможна не на всех площадках: это зависит от доступной мощности, архитектуры здания и условий эксплуатации. В коммерческих ЦОДах залы часто сильно заполнены, и любое вмешательство связано с переносом клиентских нагрузок, поэтому изменения могут затрагивать отдельные зоны, но редко площадку целиком.

В корпоративных и ведомственных ЦОДах возможностей для перераспределения ресурсов обычно больше, и изменения можно внедрять поэтапно в плановом порядке без остановки

сервисов.

Заметили неточность или опечатку в тексте? Выделите её мышкой и нажмите: Ctrl + Enter. Спасибо!